Cartographie des URLs avant refonte : la méthode propre (sans tableur infernal)

Laurent Lacoste Maintenance web

Sur une refonte, le design ne casse pas le SEO.

Ce qui casse, c’est presque toujours la même chose : une cartographie d’URLs bancale.

Parce qu’une refonte, ce n’est pas “on change le thème et on voit”.

C’est une opération où vous déplacez (ou supprimez) des centaines, parfois des milliers d’adresses. Et Google, lui, ne “devine” pas : il suit des URLs. Si vous perdez le fil, il vous le fait payer. Gentiment… mais sûrement.

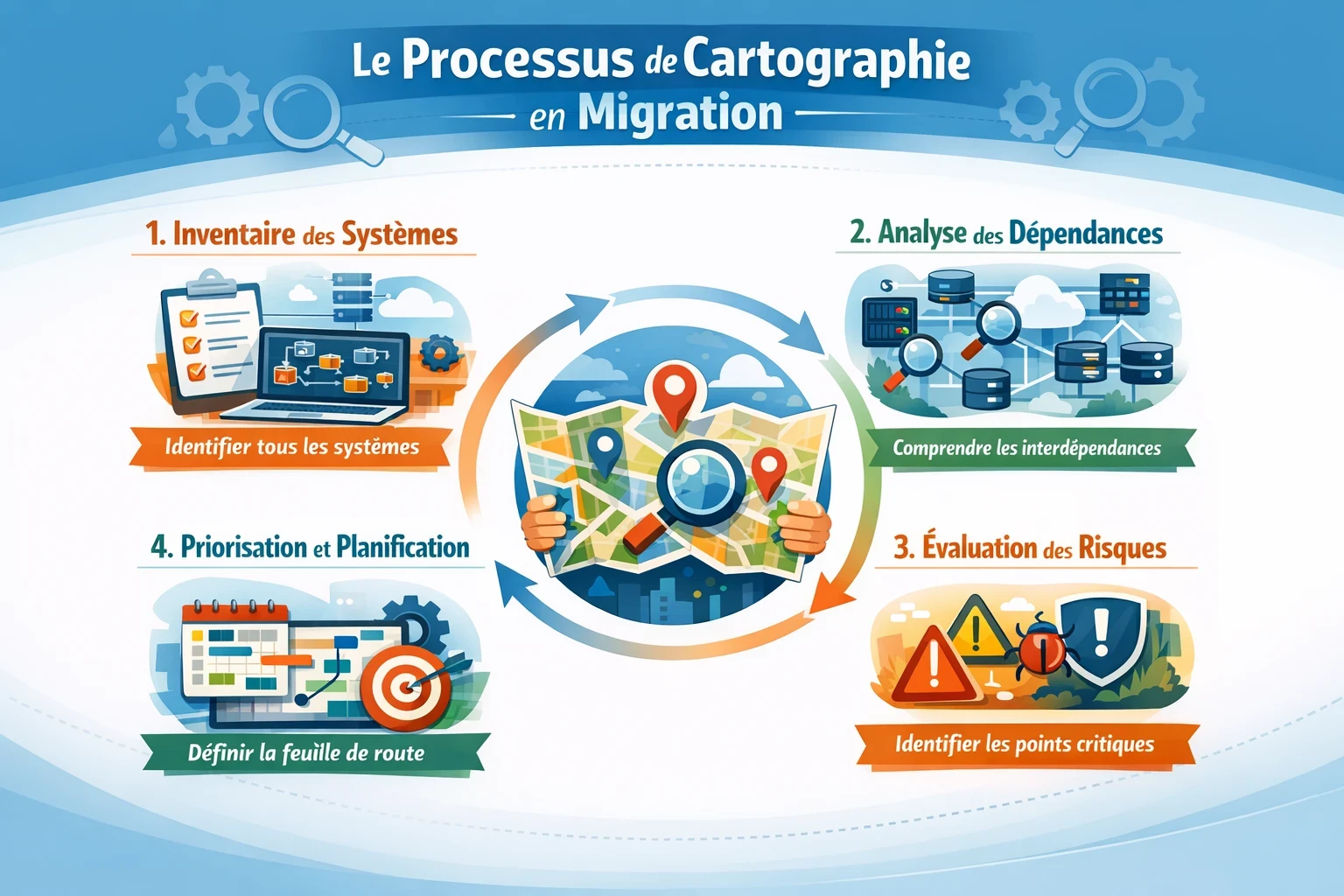

Dans cet article, je ne vais pas vous refaire le cours “plan de redirection 301” (on l’a déjà très bien cadré ailleurs). Ici, on va parler du vrai point de départ : la cartographie.

Mon objectif : qu’à la fin, vous ayez une liste canonique, propre, dédupliquée, typée et priorisée.

La seule base qui permet ensuite de faire un mapping propre, sans panique dans la Search Console.

Par Laurent Lacoste — Architecte web chez TooNetCreation

Pourquoi 80% des refontes se plantent ici (et comment vous éviter ça)

Le piège #1 : “On prend le sitemap et c’est bon”

Le sitemap, c’est votre vision déclarative : ce que le site “dit” à Google.

Le problème : ce n’est pas la réalité.

- Il manque souvent des pages (orphelines, médias, vieux contenus, pages profondes).

- Il peut contenir des URLs déjà redirigées, canonisées, ou carrément inutiles.

- Il ne vous dit pas ce que Googlebot explore vraiment.

Conclusion : sitemap seul = inventaire incomplet = refonte à l’aveugle.

Le piège #2 : “On crawle et basta”

Le crawl, c’est utile. Mais un crawl ne voit que :

- ce qui est atteignable via les liens,

- ce qui est autorisé à être crawlé.

Donc il rate :

- les pages orphelines (pas de liens internes),

- les URLs encore appelées par Google (via backlinks / anciens partages),

- les PDF / médias référencés ailleurs,

- certaines pages “techniques” (paramètres, facettes, routes internes).

Conclusion : crawl seul = inventaire partiel.

Le piège #3 : “On fera la liste pendant le mapping”

Ça, c’est mon préféré.

C’est comme dire : “on fera les fondations en posant le toit”.

Résultat : des trous, des décisions prises à la va-vite, et un mapping qui devient un chantier de rattrapage.

Le livrable attendu : la “liste canonique” (ce que vous devez viser)

Une cartographie d’URLs, ce n’est pas un export “en vrac”.

C’est un livrable exploitable : une ligne = une URL unique, avec les infos qui permettent de décider.

Définition simple

La liste canonique, c’est :

- toutes les URLs utiles (pas “toutes les URLs qui existent”)

- dédupliquées et normalisées (sinon vous mappez deux fois la même page)

- typées (catégorie, produit, page service, blog, média, etc.)

- priorisées (P1/P2/P3)

- décisionnées : conserver / fusionner / supprimer / noindex / rediriger

Si votre liste n’est pas fiable, le reste est une illusion.

Et Google déteste les illusions.

Découvrez nos articles pour approfondir sur le sujet

À relier depuis cet article pour guider le lecteur vers les ressources complémentaires.

- Guide pilier : Refonte SEO (redirections, sitemaps, recette)

Refonte SEO : redirections, sitemaps, et les pièges - Cadrer l’exploration : Robots.txt

Robots.txt expliqué : syntaxe, bonnes pratiques, impact SEO - Identifier les pages qui comptent : Google Search Console

Google Search Console : le guide pour améliorer son SEO - Éviter les doublons : Cannibalisation SEO

Cannibalisation SEO : l’identifier et la corriger - Cas concret e-commerce : migration PrestaShop → WooCommerce

Migration PrestaShop → WooCommerce : SEO avant/après

Le modèle de cartographie (colonnes minimales + optionnelles)

Je vous donne ici le minimum vital.

Oui, ça fait plusieurs colonnes. Non, ce n’est pas “un tableur infernal”.

C’est juste un outil de pilotage.

Colonnes minimales (obligatoires)

Colonne | À quoi ça sert | Exemple |

url | l’URL source (unique) | /services/seo/ |

type | typologie (pour trier vite) | service, blog, category, media |

http_status | vérifier l’état réel | 200, 301, 404 |

indexability | indexable / noindex / bloquée | indexable |

canonical | cible canonical si présente | https://.../url-canonique/ |

source | d’où vient l’URL | crawl, gsc, logs, sitemap, cms |

priority | P1/P2/P3 | P1 |

decision | quoi faire après | keep, merge, noindex, redirect, 410 |

owner | qui valide | SEO, Tech, Client |

Colonnes “confort” (fortement recommandées)

Colonne | Pourquoi c’est précieux |

gsc_clicks_16m / gsc_impressions_16m | la valeur SEO réelle |

ga4_sessions_12m / leads | la valeur business |

backlinks | les pages qui portent l’autorité |

notes | cas particuliers, pièges, exceptions |

test_status / test_date | éviter le “on pensait que…” |

Comment vous allez travailler (sans devenir fou)

Pour que ce soit fluide, on va avancer en 3 gestes :

- Collecter (croiser plusieurs sources, sinon vous ratez des pages)

- Nettoyer (normaliser + dédupliquer + virer le bruit)

- Qualifier (type + priorité + décision)

“A retenir”

Une cartographie fiable, c’est un livrable décisionnel : unique, typé, priorisé, actionnable.

Un sitemap ou un crawl seul, c’est une photo partielle.

Objectif : sortir une liste canonique qui permet de travailler vite, proprement, et sans surprise.

On a fixé le vrai livrable : la liste canonique.

Maintenant, on attaque le nerf de la guerre : la collecte.

Je vous préviens avec tendresse : si vous ne croisez qu’une seule source, vous aurez forcément une cartographie incomplète. Et une cartographie incomplète, c’est un plan de migration qui ressemble à un gruyère. (Je vous laisse imaginer la suite…)

Collecte : les 6 sources à croiser (et ce que chacune révèle)

1) Le crawl (la photo “structure” du site)

Ce que ça donne : toutes les pages accessibles via le maillage, avec leurs codes HTTP, canonicals, noindex, hreflang, etc.

Pourquoi c’est utile :

- vous récupérez la structure réelle (catégories, pages, blog…)

- vous sortez les erreurs visibles (4xx, 5xx, chaînes 3xx…)

- vous voyez les signaux SEO techniques en masse

Ce que ça ne voit pas :

- les pages orphelines (zéro lien interne)

- des URLs encore visitées par Google via backlinks anciens

- parfois les médias et ressources “hors arbo”

Conseil terrain :

- faites 2 crawls :

- un crawl “normal” (respect robots)

- un crawl “diagnostic” (pour voir ce que bloque le robots.txt, si vous avez le droit / sur une copie)

- exportez au minimum : url, status, indexability, canonical, inlinks, title, h1, type.

2) Les sitemaps XML (la liste “déclarée”)

Ce que ça donne : ce que le site déclare comme important et indexable.

Pourquoi c’est utile :

- souvent, c’est la liste la plus propre… quand elle est bien gérée

- bon point de départ pour les contenus “officiels” (pages, catégories, articles)

Ce que ça trahit (souvent) :

- sitemaps pas à jour

- URLs redirigées dedans (oui, ça arrive…)

- pages qui devraient être exclues mais qui sont listées

Conseil terrain :

- récupérez tous les sitemaps (index + sous-sitemaps).

- contrôlez vite :

- uniquement des 200

- uniquement des URLs indexables

- pas d’URLs canonisées vers autre chose

3) Google Search Console (la vision “Google”)

Là, on arrête de supposer. On regarde ce que Google a réellement vu et aimé.

Ce que ça donne :

- pages qui génèrent clics & impressions

- requêtes associées (donc intention)

- pages découvertes mais pas indexées / indexées puis sorties / erreurs

Pourquoi c’est vital :

- vous identifiez vos pages “argent” et vos pages “SEO”

- vous récupérez des URLs qu’un crawl peut rater (orphelines, anciennes)

Exports utiles :

- Performance → Pages (sur 16 mois)

- Couverture / Indexation → pages avec états problématiques

- Liens → pages les plus linkées (minimum vital)

Conseil terrain :

- exportez le Top pages (par clics) + un export plus large (impressions).

- marquez ces URLs comme candidates P1 dès le départ.

4) Les logs serveur (la vérité “Googlebot en prod”)

Si je devais n’en garder qu’un avec la GSC : les logs.

Ce que ça donne :

- toutes les URLs réellement crawlées par Googlebot

- les fréquences de crawl (ce qui compte, ce qui revient souvent)

- les 404/500 que Google rencontre (même si vous ne les voyez pas ailleurs)

Pourquoi c’est puissant :

- ça révèle des URLs fantômes :

- anciennes URLs qui tournent encore

- PDF / images / endpoints

- paramètres qui gonflent le crawl budget

- ça permet de trancher : “est-ce que Google y va vraiment ?”

Conseil terrain :

- prenez 30 jours minimum (idéal 60-90 jours)

- filtrez par user-agent Googlebot (et Bingbot si vous voulez être complet)

- sortez : url, status, hits, last_seen, bot.

5) L’export CMS (la vision “métier”)

Le crawl et Google peuvent rater des choses. Le CMS, lui, sait ce qui existe “dans la base”.

Ce que ça donne :

- la liste exhaustive des contenus : pages, articles, produits, catégories

- statuts (publié/brouillon), langue, ID, parent/enfant

Pourquoi c’est utile :

- vous identifiez ce qui existe même si ce n’est pas bien lié

- vous repérez les contenus à supprimer / consolider

- vous préparez des règles de slugs propres côté futur site

Conseil terrain :

- exportez au moins : id, title, slug, url, status, type, lang, category.

6) Les backlinks (la couche “autorité”)

Pas besoin d’un outil à 300€/mois pour faire le minimum vital.

Déjà, la Search Console vous donne une base.

Ce que ça donne :

- les pages qui reçoivent des liens externes

- donc les pages qui portent souvent le “jus”

Pourquoi c’est critique :

- si une page linkée finit en 404 → vous perdez de l’autorité

- si elle est redirigée n’importe comment → vous diluez

Conseil terrain :

- récupérez la liste des pages les plus linkées (GSC).

- mettez un flag : backlink=1 et considérez ça comme P1 ou P2 selon trafic.

Méthode simple pour fusionner sans vous noyer

Étape A — Tout mettre “dans la même baignoire”

Vous avez 6 exports → vous voulez un seul fichier (ou une base), avec une colonne source.

Règle : une URL = une ligne.

Mais pour l’instant, vous acceptez les doublons : on dédupliquera après.

Étape B — Normaliser (avant de dédupliquer)

Sinon vous aurez :

- http:// vs https://

- www vs non-www

- /page vs /page/

- paramètres, UTM, casse…

On normalise d’abord, on déduplique ensuite. Toujours.

Étape C — Dédupliquer avec une logique

- si la même URL vient de 3 sources, vous la gardez 1 fois

- et vous mettez source = crawl|gsc|logs (multi-valeurs)

Une URL qui vient des logs + GSC, je la regarde avec plus de respect.

Elle a probablement une vraie vie.

La checklist “collecte propre” (à copier/coller)

✅ Crawl complet exporté (codes, indexabilité, canonical, inlinks)

✅ Tous les sitemaps récupérés (index + sous-sitemaps)

✅ GSC export Pages (clics + impressions) + Liens externes

✅ Logs (30j mini) filtrés Googlebot + export URLs + hits + status

✅ Export CMS (pages/articles/produits/catégories + statuts)

✅ Backlinks : au minimum GSC, idéalement enrichi si vous avez un outil

Mini-tableau : quel outil répond à quelle question ?

Question | Source la plus fiable |

“Quelles URLs existent et sont liées ?” | Crawl |

“Quelles URLs le site déclare ?” | Sitemap |

“Quelles URLs performent SEO ?” | GSC |

“Quelles URLs Googlebot crawle vraiment ?” | Logs |

“Quelles URLs existent dans le contenu ?” | CMS export |

“Quelles URLs portent de l’autorité ?” | Backlinks (GSC) |

“A retenir”

On fait le boulot qui sépare les migrations propres des migrations “on verra bien” :

nettoyage + normalisation + dédup + typologie + scoring P1/P2/P3, avec un exemple clair de règles (paramètres, facettes, recherche interne, médias…).

Et maintenant comment créer une liste canonique ?

On a fait le plus ingrat : collecter (crawl, sitemaps, GSC, logs, CMS, backlinks).

Maintenant, on passe à ce qui fait vraiment la différence entre une carto “à peu près” et une carto exploitable : nettoyer + normaliser + dédupliquer + typer + prioriser.

C’est la phase où, très concrètement, vous transformez “un tas d’URLs” en liste canonique.

Étape 1 : normaliser (avant de dédupliquer, sinon vous vous auto-piégez)

Normalisation : la règle simple

Une URL doit exister dans un format unique, sinon vous allez :

- compter deux fois la même page,

- mapper des doublons,

- et vous retrouver avec des incohérences de décision (keep/redirect/noindex) sur la même ressource.

Checklist de normalisation (rapide mais indispensable)

Décidez et appliquez UNE convention :

- https partout (pas http)

- host canonique : www ou non-www (choisissez)

- trailing slash : /page/ ou /page (choisissez)

- minuscules (si votre stack le permet, sinon attention)

- suppression des fragments #… (jamais une URL canonique)

- tri des paramètres (ou suppression des paramètres non SEO)

Petite perfide vérité : si vous ne normalisez pas, votre “déduplication” ne sert à rien.

C’est comme trier des chaussettes… en gardant les yeux fermés.

Étape 2 : gérer les paramètres (le vrai nid à “tableur infernal”)

Les paramètres sont la source n°1 de bruit :

?utm_source=…, ?orderby=…, ?filter=…, ?color=…, etc.

Ma règle terrain (simple)

On distingue 3 familles :

A) Paramètres marketing (UTM & co) → on les ignore

- utm_*, gclid, fbclid, msclkid, mc_*…

➡️ Ils ne doivent pas créer de nouvelles URLs dans la carto.

On conserve l’URL sans paramètres comme référence.

B) Paramètres de tri / pagination → souvent non SEO

- ?sort=, ?orderby=, ?page=, ?p=

➡️ généralement : noindex, canonical vers l’URL propre, et surtout pas dans le sitemap.

C) Paramètres de facettes / filtres → à cadrer

- ?size=, ?color=, ?brand=

➡️ parfois indexable (rare), souvent noindex + canonical.

Le piège : laisser ça proliférer → index qui enfle → crawl budget dilué.

Tableau décisionnel (simple, efficace)

Type d’URL | Exemple | Dans la carto ? | Décision habituelle |

UTM | /produit-x/?utm_source=nl | ❌ | Ignorer (garder URL propre) |

Tri | /categorie/?orderby=price | ⚠️ | noindex + canonical |

Pagination | /blog/page/2/ | ⚠️ | dépend : souvent indexable, mais à cadrer |

Facette | /chaussures?color=noir | ⚠️ | souvent noindex |

Facette SEO | /chaussures-noires/ | ✅ | page dédiée (URL propre) |

Étape 3 : dédupliquer proprement (avec une logique de priorité)

Déduplication : comment décider “quelle version garder” ?

Quand vous avez plusieurs variantes d’une même page, gardez l’URL canonique “référence”.

Ordre de préférence (généralement) :

- URL 200 (finale)

- URL indexable

- URL sans paramètres

- URL canonique (si canonical déclaré)

- URL la plus utilisée (logs / GSC)

Et surtout : gardez la trace des autres sous forme de colonne :

- variants_detected (ou duplicate_of)

- et sources multiples (crawl|gsc|logs|…)

Une URL dupliquée supprimée sans trace, c’est une future surprise.

Et moi, les surprises en prod… je les préfère au chocolat.

Étape 4 : typologie (classer pour travailler 10x plus vite)

Le but : pouvoir filtrer votre carto en 2 secondes.

Typologie recommandée (pragmatique)

- home

- service / money_page

- category

- product

- blog

- cms (pages institutionnelles)

- media (pdf, images)

- search (recherche interne)

- facet (filtres)

- account / checkout (espaces privés)

- other

Exemple : règles simples pour auto-typer

- si URL contient /wp-content/ ou /media/ → media

- si URL contient ?s= ou /search → search

- si URL contient ?filter → facet

- si URL commence par /blog/ → blog

- si URL contient /produit/ → product

Même sans automatisation, ces règles vous servent de guide pour faire vite.

Étape 5 : scoring P1/P2/P3 (le tri qui sauve votre migration)

Je vous donne une méthode simple. Pas parfaite. Mais actionnable.

Définition

- P1 : ce qui génère business ou autorité (trafic, leads, CA, backlinks)

- P2 : pages utiles mais secondaires (potentiel SEO, longue traîne propre)

- P3 : faible valeur / bruit / pages techniques / duplications

Règles terrain (à adapter)

P1 si :

- page dans le top GSC (clics) OU

- reçoit des backlinks (GSC Liens) OU

- page génère leads/CA (GA4) OU

- page “money” stratégique (services, catégories top)

P3 si :

- facettes non SEO

- recherche interne

- tri, filtres, paramètres

- pages “compte”, “panier”, “checkout” (sauf cas particulier)

- pages 404/410 historiques (à traiter, pas à conserver)

Mini-tableau de scoring (simple)

Signal | Points |

Backlinks présents | +3 |

Clics GSC significatifs | +3 |

Sessions GA4 SEO / leads | +3 |

Page service / catégorie stratégique | +2 |

URL technique (facet/search/sort) | -3 |

Non indexable / canonisée ailleurs | -2 |

Interprétation :

- ≥ 5 → P1

- 2 à 4 → P2

- ≤ 1 → P3

Étape 6 : décision (la cartographie devient un plan d’actions)

C’est ici qu’on transforme la carto en quelque chose d’utile.

Décisions possibles (colonne decision)

- keep : on conserve (URL identique ou future URL stable)

- redirect : redirection vers équivalent (souvent P1)

- merge : consolidation N→1 (doublons / contenus faibles)

- noindex : on garde mais on sort de l’index (souvent facet/search)

- 410 : supprimé définitivement sans équivalent

- review : à valider (client / métier)

Tableau “type → décision” (raccourci très efficace)

Type | Décision la plus fréquente |

service / money_page | keep ou redirect (P1) |

blog | keep, merge (doublons), parfois redirect |

category/product | keep ou redirect (P1/P2) |

media (PDF) | keep ou redirect (souvent oublié !) |

facet/search/sort | noindex ou exclusion |

account/checkout | exclusion de la carto SEO (souvent) |

Exemple de “liste canonique” (mini-extrait)

url | type | status | sources | gsc_clicks | backlinks | priority | decision | notes |

/services/seo/ | service | 200 | crawl|gsc | 320 | 2 | P1 | keep | page business |

/blog/guide-x/ | blog | 200 | crawl|gsc | 90 | 0 | P2 | keep | ok |

/categorie/?orderby=price | facet | 200 | logs | 0 | 0 | P3 | noindex | tri |

/docs/guide.pdf | media | 200 | logs|gsc | 12 | 1 | P2 | keep | backlinks sur PDF |

Contrôles qualité (les 5 vérifs qui évitent les “oups”)

- Les Top pages GSC sont bien présentes et en P1/P2

- Les URLs vues dans les logs (Googlebot) sont couvertes (même si décision = noindex/410)

- Les médias/PDF importants ne sont pas oubliés

- Les paramètres sont maîtrisés (UTM ignorés, facettes cadrées)

- Vous avez une décision pour 90% des lignes (le reste = review)

Et maintenant ? le pilotage

On y est : vous avez collecté, nettoyé, dédupliqué, typé, scoré.

À ce stade, votre cartographie n’est plus “un fichier” : c’est un pilotage.

Il reste 2 choses à faire pour que ce soit vraiment carré :

- Transformer la carto en livrable livrable (oui, j’insiste) : actionnable, testable, transmissible.

- Mettre les garde-fous qui évitent les surprises (404, pages oubliées, facettes qui explosent, médias perdus, etc.).

Et promis : on ne refait pas le guide “Refonte SEO” ici. On reste sur notre sujet : la cartographie.

De la cartographie à un plan d’actions propre (sans se disperser)

1) La sortie attendue : “Carto v1 → Carto validée”

Dans un projet sérieux, votre carto passe par 3 états simples :

- V1 (brute mais nettoyée) : collecte OK, normalisation OK, typologie OK

- V2 (scorée + décisions) : P1/P2/P3 + decision (keep/merge/noindex/410/redirect)

- V3 (validée + verrouillée) : owners ont validé, ambiguïtés tranchées, prête pour exécution

Ce que ça change : vous n’êtes plus en mode “on verra”. Vous êtes en mode “on sait”.

2) La règle des “décisions avant solutions”

Je le répète souvent en migration :

décider d’abord, implémenter ensuite.

Sinon vous tombez dans les pièges :

- on code une redirection… puis on apprend que la page devait être fusionnée,

- on garde des pages “par précaution”… puis on traîne du thin content éternellement,

- on noindex des filtres… puis on découvre qu’ils rankaient.

Donc on verrouille ces décisions :

- keep : on garde la page (et idéalement son intention)

- merge : N→1 (vous choisissez la page canonique)

- noindex : on sort du jeu SEO sans supprimer

- 410 : on assume la suppression (et on nettoie le sitemap)

- redirect : on sait vers quoi ça doit atterrir (au moins le type de cible)

Le “pack livrable” : ce que je rends à un client (ou à mon équipe)

Livrable 1 — Cartographie canonique (CSV)

Colonnes minimales (rappel) :

url | type | http_status | indexability | canonical | sources | priority | decision | owner | notes

Livrable 2 — Liste “P1” (extrait séparé)

Un extrait filtré “P1 only” (souvent 5 à 20% des URLs).

Pourquoi ? Parce que c’est votre liste de contrôle : ce sont les pages qui ne doivent pas se perdre.

Livrable 3 — Liste “exclusions” (facettes / recherche / tri)

Une liste séparée facet/search/sort avec décisions : noindex/exclusion/keep.

C’est là qu’on évite l’effet “index qui gonfle”.

Livrable 4 — Journal des points à risque

Un mini-log “risques” :

- anciennes URLs très crawlées (logs) mais absentes du maillage

- PDF linkés

- pages canonisées bizarrement

- paramètres hors contrôle

C’est la partie “je vous évite une séance de panique dans 3 semaines”.

Les contrôles qualité avant de dire “carto OK”

Voici ma checklist de validation. Simple. Brutale. Efficace.

Checklist “Carto validée”

✅ Top pages GSC présentes + marquées P1/P2

✅ Pages linkées externes (GSC Liens) présentes + flag backlinks

✅ URLs Googlebot (logs) couvertes (même si décision = noindex/410)

✅ 0 doublon sur l’URL normalisée

✅ Paramètres maîtrisés (UTM ignorés, facettes classées)

✅ Médias/PDF listés (au moins ceux vus en logs ou linkés)

✅ Décision définie pour ≥ 90% des lignes (le reste = review + owner)

Petit indicateur malin

Si vous avez plus de 20–30% d’URLs en review, vous êtes encore dans le flou.

Il faut trancher avant d’aller plus loin.

“OK, et après ?” (sans cannibaliser le guide Refonte SEO)

Ce que votre cartographie permet immédiatement

- préparer un mapping propre (à partir des décisions)

- bâtir une stratégie de consolidation (merge)

- nettoyer l’index (noindex / exclusions)

- verrouiller les pages à protéger (P1)

Ce que je ne détaille pas ici (volontairement)

- l’implémentation complète des redirections 301/308

- la stratégie sitemaps + recette Jour J + monitoring S+30

Pour ça, on a déjà un guide complet “Refonte SEO : redirections, sitemaps…” signé Georges.

Et c’est volontaire : un article = une intention. Sinon, Google hésite. Et vous aussi.

Maillage interne recommandé (hiérarchique, propre)

Dans cet article (celui-ci), je recommande 3 liens sortants internes maximum, bien placés :

- Vers le guide pilier refonte (stratégie complète)

→ “Refonte SEO : redirections, sitemaps, et les pièges…”

(à placer en fin d’article ou après la section “OK, et après ?”) - Vers le cas e-commerce (si migration boutique)

→ “Migration PrestaShop → WooCommerce : SEO avant/après”

(à placer dans un encart “si e-commerce”) - Vers votre article cannibalisation (si besoin de diagnostic)

→ “Cannibalisation SEO : comment l’identifier…”

(à placer dans la partie “risques” ou “décisions”)

“À retenir”

Une cartographie d’URLs réussie, ce n’est pas un export.

C’est une liste canonique : complète, dédupliquée, typée, priorisée, avec une décision par URL.

Sans ça, tout le reste (mapping, redirections, sitemaps) devient un bricolage.

“Si vous manquez de temps : faites au moins ça”

- Export GSC Pages (clics/impressions) + Liens externes

- Logs Googlebot 30 jours (URLs + hits + status)

- Crawl du site (status + canonical + indexabilité)

- Fusion + dédup + liste P1

➡️ Même en version “light”, ça évite les grosses pertes.

Que retenir au final ?

La cartographie, c’est votre assurance anti-casse.

Vous pouvez avoir la meilleure équipe, le plus beau site, le meilleur CMS…

Si votre inventaire est faux, votre refonte sera un pari.

Faites simple :

- 6 sources,

- une URL = une ligne,

- normalisation + dédup,

- typologie + P1/P2/P3,

- une décision par URL.

Et ensuite seulement, vous déroulez la migration.

Vous avez une refonte ou une migration qui arrive ?

On peut vous faire une cartographie “light mais carrée” : inventaire multi-sources, scoring P1/P2/P3, décisions (keep/merge/noindex/410), et livrable prêt à transmettre.

(Et promis : on évite le tableur infernal. On préfère les listes propres.)

FAQ express

“Combien de temps ça prend ?”

Ça dépend du volume, mais la vraie réponse c’est :

moins de temps que de réparer une migration ratée.

En pratique, une carto “light mais carrée” se fait vite si vous avez accès aux sources (GSC + crawl + logs).

“Je dois vraiment utiliser les logs ?”

Si vous pouvez : oui.

Les logs montrent ce que Googlebot fait réellement. Et ça, aucun crawl ne l’invente.

“Et si j’ai un site énorme ?”

Encore plus raison d’être méthodique : typologie + scoring.

Vous ne traitez pas 100 000 URLs une par une : vous traitez P1 en exact, le reste par règles (et décisions).

Prêt à concrétiser votre projet ?

Posez nous toutes vos questions et nous vous aiderons à y voir plus clair.