Analyse de fichiers journaux : l’outil SEO sous-estimé qui dit la vérité sur votre site

Laurent Lacoste Cyber sécurité

Quand je parle d’analyse de logs, beaucoup lèvent les yeux au ciel. “Encore un truc technique pour les développeurs…”

Erreur. Les fichiers journaux sont les seules données qui ne mentent pas : ils enregistrent tout ce qui touche votre serveur. Vous voulez savoir comment Google explore réellement votre site ? Ce que voit un bot d’IA ? Où vous perdez du budget d’exploration ?

→ Les logs ont la réponse.

Bienvenue dans un tour d’horizon simple, humain et actionnable de ce que j’utilise au quotidien pour optimiser des sites — du petit artisan au mastodonte e-commerce. Découvrez notre offre maintenance qui fait la différence.

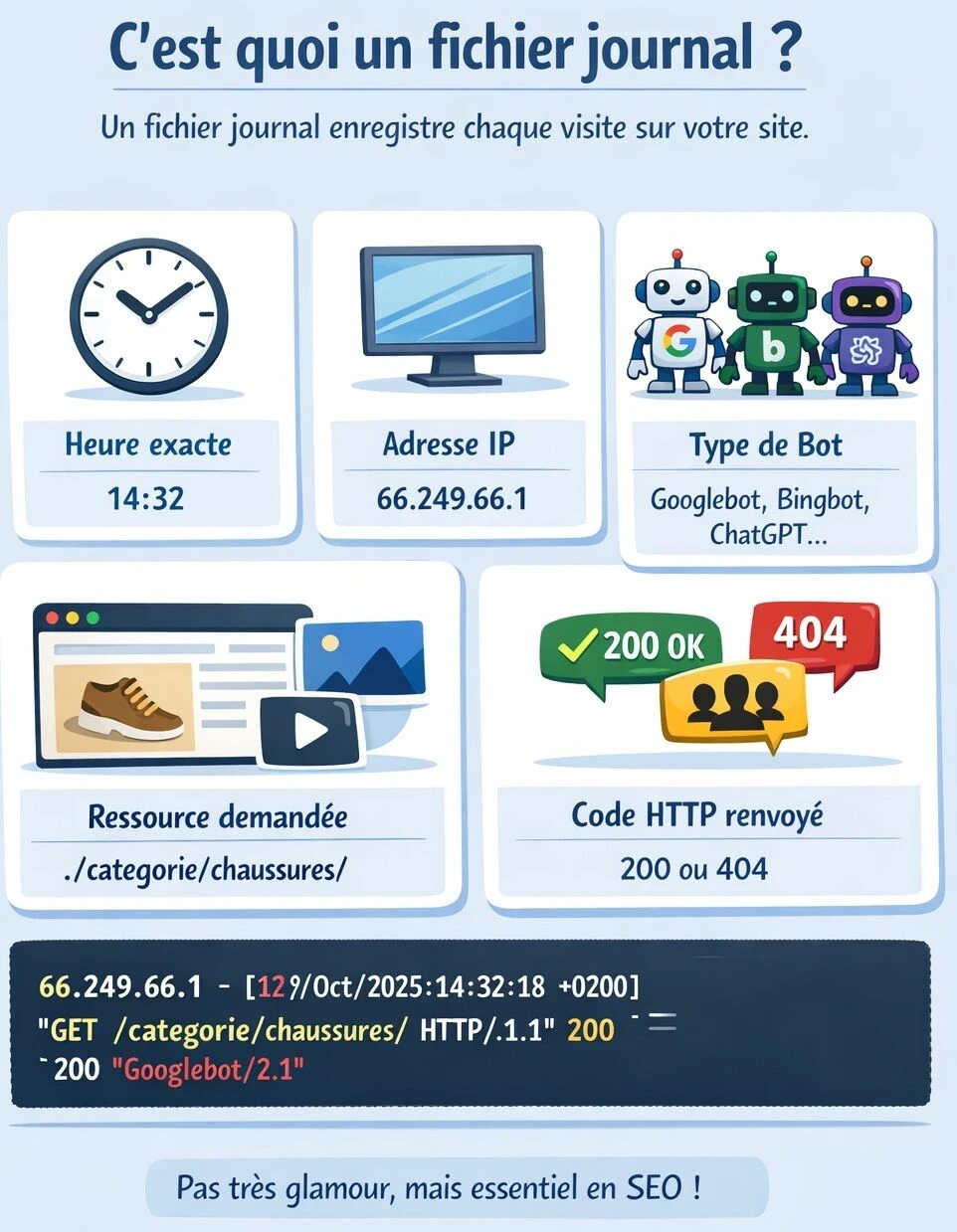

C’est quoi un fichier journal ? (La version claire, pas la version RFC 1392)

Un fichier journal (ou log serveur) contient une ligne à chaque fois que quelqu’un — humain ou robot — demande une ressource sur votre site.

Chaque ligne vous révèle :

- l’heure exacte

- l’IP qui a demandé la ressource

- le type de bot (Googlebot, Bing, ChatGPT, etc.)

- la ressource demandée : page HTML, image, script…

- le code HTTP renvoyé : 200, 301, 404…

Ça ressemble à ça :

66.249.66.1 - - [12/Oct/2025:14:32:18 +0200] "GET /categorie/chaussures/ HTTP/1.1" 200 5320 "-" "Googlebot/2.1"

Rien de très sexy, mais c’est la vérité terrain.

Et la vérité, en SEO, ça vaut de l’or.

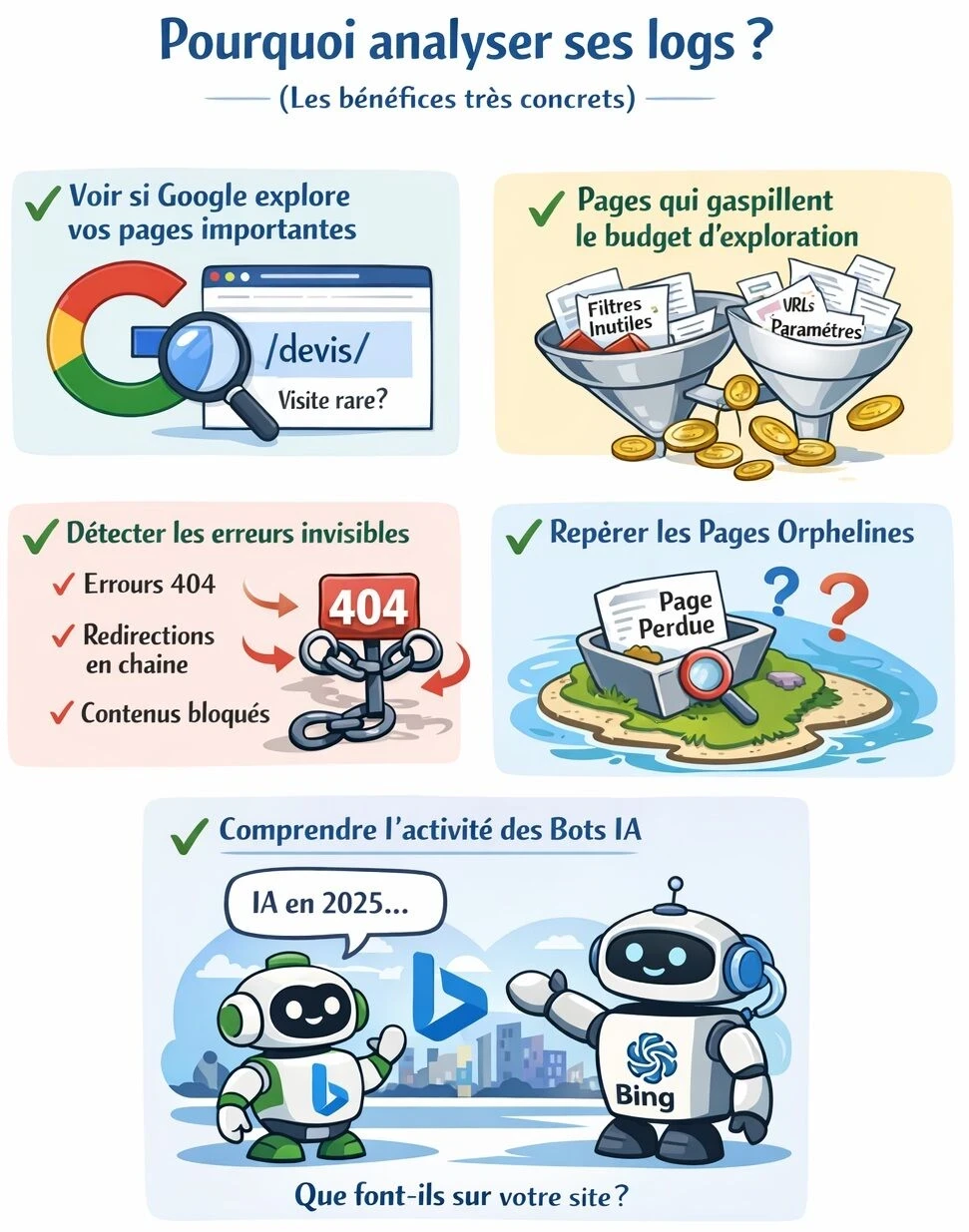

Pourquoi analyser ses logs ? (Les bénéfices très concrets)

L’analyse des fichiers journaux vous permet de :

✔ Voir si Google explore vos pages importantes

Si votre page stratégique “/devis/” n’est explorée que deux fois par mois, c’est un problème.

✔ Identifier les pages qui gaspillent votre budget d’exploration

Pages de filtres, variantes produits, archives vides, URLs paramétrées inutiles…

✔ Détecter les erreurs invisibles dans un audit classique

- erreurs 404 fantômes

- redirections en chaîne

- contenus inaccessibles aux bots

- boucles de redirection générées par le CMS

✔ Repérer les pages orphelines

Oui, celles que personne n’a jamais linkées.

Les logs vous diront si un bot les trouve quand même… ou pas du tout.

✔ Comprendre comment les bots IA interagissent avec votre site

Oui, en 2025, les bots d’IA crawlent massivement les sites.

Certaines IA piochent dans vos contenus pour répondre à vos utilisateurs.

Il est temps de savoir où elles vont.

Si le sujet vous intéresse, voici des articles sur le même sujet

- Crawl Budget : les fondamentaux

- Les erreurs SEO techniques qui nuisent à votre référencement

- Comment savoir si votre site a été pénalisé par Google

- Optimiser un site Joomla pour le SEO : techniques & outils 2025

- Utiliser la Search Console pour améliorer réellement son SEO

Comment accéder à vos fichiers journaux ? (Simple et concret)

Trois options :

1. Via votre hébergeur

La plupart proposent un dossier .logs dans le gestionnaire de fichiers.

2. Via FTP

FileZilla & co :

dossier /logs, /access_logs ou /apache_logs.

3. Via votre développeur / admin système

Le plus safe si vous n’êtes pas à l’aise, surtout si un reverse proxy ou un CDN (Cloudflare, Nginx, Traefik) est en place.

Téléchargez les 30 derniers jours : c’est un bon début.

Comment analyser ses logs ? (Méthode Laurent, éprouvée sur des années)

Je vous partage ma façon de faire, celle que j’utilise sur des sites e-commerce gourmands ou des sites institutionnels exigeants.

Étape 1 — Chercher les anomalies évidentes

Questions clés :

- Quelles sont les pages les plus explorées ?

- Quelles sont celles jamais visitées par Google ?

- Quels codes HTTP reviennent le plus ?

- Y a-t-il des pics de crawl anormaux ?

Les anomalies les plus fréquentes :

- pages filtres explorées 10x plus que les pages catégories

- redirections multiples non identifiées par le CMS

- Googlebot perdu sur des URLs internes non prévues

- JS/CSS trop crawlé au détriment de vos pages importantes

Étape 2 — Vérifier le crawl des pages stratégiques

Posez-vous cette question simple :

“Est-ce que Google passe son temps où je veux qu’il passe son temps ?”

Exemples :

- si vous vendez des services → pages “Prestations”, “Contact”, “Devis”

- si vous êtes e-commerce → catégories + produits top ventes

- si vous êtes un artisan → pages locales : “Climatisation Toulouse”, “Dépannage Blagnac”…

Si elles sont peu crawlées → priorité absolue.

Étape 3 — Traquer les erreurs (les vraies)

Les erreurs logs ≠ les erreurs que votre CMS détecte.

Les logs montrent :

- 404 récurrentes

- boucles 301 > 302 > 200

- pages interdites mais pourtant sollicitées

- ressources JS cassées qui empêchent le rendu

Chaque erreur consomme du budget.

Chaque erreur ralentit la compréhension de votre site.

Étape 4 — Repérer les URLs inutiles

Les logs adorent révéler ces horreurs :

- /?ref=facebook123

- /?sort=alpha&color=blue&price=low

- /old/ encore en ligne après la refonte

- /test/ visité 400 fois parce qu’un bot s’y perd

Action rapide :

robots.txt + canonicals + nettoyage du CMS.

Votre budget d’exploration vous dira merci.

Étape 5 — Observer les bots IA

En 2025, c’est devenu indispensable.

Vous verrez des choses comme :

- ChatGPT-User

- ClaudeBot

- PerplexityBot

- Google-Extended

Pourquoi c’est utile ?

Parce que ces bots construisent des réponses basées sur vos contenus.

Ils peuvent devenir un canal de visibilité supplémentaire, mais seulement si votre contenu est accessible, propre et bien maillé.

Comment éviter que Google explore n’importe quoi ?

✔ robots.txt

Bloquez les URLs inutiles, archives vides, paramètres superflus.

✔ Balises canoniques

Indispensable pour les variantes (produits, pagination, filtres).

✔ Suppression / fusion de contenus faibles

Plus un site grossit, plus il a besoin d’entretien.

C’est comme un potager : si vous ne taillez pas, ça s’étouffe.

À quelle fréquence analyser ses logs ?

Pour un petit site : 2 fois par an, c’est suffisant.

Pour un e-commerce, un média, un site d’artisan saisonnier : tous les mois.

Ce que les logs vous apportent réellement

En résumé :

- une vision réelle, pas théorique

- des décisions SEO basées sur des preuves

- la maîtrise de votre budget d’exploration

- un meilleur positionnement dans la recherche classique et dans les IA

C’est la boussole technique la plus fiable que je connaisse.

Logs & cybersécurité : votre première ligne de défense contre les attaques

Si je devais résumer 20 ans de gestion de serveurs et de Web Factory :

quand un site se fait attaquer, les logs sont souvent les premiers à parler.

Bien avant votre firewall, bien avant votre CMS, bien avant votre monitoring.

Les fichiers journaux sont comme des caméras de surveillance :

✔ ils enregistrent tout

✔ ils ne dorment jamais

✔ ils montrent les anomalies avant les dégâts

Détecter les attaques grâce aux logs

Voici ce que les logs révèlent immédiatement lors d’une tentative d’intrusion :

• Tentatives de brute-force (admin/wp-login/administrator…)

Une rafale d’appels sur :

/wp-login.php, /administrator/index.php, /user/login

→ mauvais signe.

Les bots testent des milliers de combinaisons pour entrer.

• Exploration massive de pages inexistantes

Exemple :

/wp-config.bak, /phpmyadmin/, /sqladmin/

→ ils cherchent une faille.

• Appels suspects sur des fichiers sensibles

Comme :

/.env, /config.php.old, /backup.zip

→ ces fichiers ne devraient jamais être publics.

• Pics d’activité soudains depuis un même pays ou un même ASN

Un IP unique qui génère 2 000 hits en 10 minutes ?

→ Ce n’est pas un fan. C’est une attaque automatisée.

• Signatures de scanners ou d’outils comme Nikto, Skipfish, Dirsearch

Les User-Agents des attaquants ne sont pas toujours subtils.

Comment réagir rapidement ? (La méthode Laurent, simple et efficace)

Étape 1 : Identifier l’IP malveillante

Analysez les patterns : répétitifs, agressifs, anormaux.

Étape 2 : Bloquer côté serveur

Via :

- firewall (fail2ban, mod_security, Cloudflare)

- htaccess

- firewall applicatif

Étape 3 : Vérifier qu’aucune ressource sensible n’a été accessible

Surtout :

- fichiers de configuration

- répertoires de sauvegarde

- scripts oubliés

Étape 4 : Forcer les mises à jour du CMS / plugins / extensions

Une attaque détectée =

→ vérifier WordPress, Joomla, PrestaShop, et tous les plugins.

Étape 5 : Activer davantage de logs si nécessaire

Parfois, les logs “normaux” ne suffisent pas.

Les niveaux debug ou extended permettent d’identifier la faille exacte (mais attention à ne pas laisser ce niveau actif en production trop longtemps).

Les attaques les plus fréquentes révélées grâce aux logs

Type d’attaque | Signature observable dans les logs | Risques |

Brute-force | centaines de POST sur /login | Compte admin compromis |

Scan de vulnérabilités | Liste interminable de 404 sur fichiers sensibles | Découverte de faille |

Injection SQL | URLs contenant ?id=1 OR 1=1 | Base de données exposée |

LFI / RFI | appels type /../../etc/passwd | Accès fichiers système |

Bots IA trop gourmands | milliers de GET sur des pages lourdes | Saturation du serveur |

DDoS léger | rafales d’accès sur une page légère | Dégradation performance |

Pourquoi les logs sont essentiels pour la sécurité

Les logs permettent de :

- voir une attaque avant qu’elle ne réussisse

- comprendre comment l’attaquant procède

- documenter l’incident pour un prestataire cyber

- prouver qu’une compromission vient d’un comportement externe

Et pour les sites d’entreprise :

sans logs, impossible d’être conforme RGPD en cas d’incident.

Coupler logs + SEO pour sécuriser ET optimiser

Quand on met les deux ensemble, on voit des choses très utiles :

- une attaque brute-force peut réduire la vitesse du site → performance SEO en baisse

- des bots malveillants peuvent consommer votre budget d’exploration

- des erreurs 500 dues à un pic d’attaque peuvent faire chuter votre indexation

- un script vulnérable peut casser le rendu Google → pages non explorées

Les logs, c’est un système d’alerte précoce autant qu’un outil de diagnostic SEO.

Que retenir ? les logs, c’est moche… mais c’est puissant.

Je le dis souvent à mes équipes :

“Le SEO moderne, c’est 50% stratégie, 30% technique… et 20% lecture de fichiers que personne ne veut ouvrir.”

L’analyse de logs n’est pas glamour, mais c’est redoutablement efficace.

C’est l’un des rares outils qui montre comment Google comprend vraiment votre site.

Vous voulez qu’on regarde vos logs ensemble ?

On peut faire ça autour d’un café, ou d’une bière (maison) si vous passez à Toulouse.

Besoin d’y voir clair dans vos logs (et dans votre SEO) ?

Les fichiers journaux racontent toute l’histoire de votre site : ce que Google voit, ce qu’il ignore, ce qui freine votre référencement… et parfois même ce qui menace votre sécurité.

Si vous voulez un diagnostic propre, technique et actionnable, je peux analyser vos logs, détecter les anomalies, optimiser votre budget d’exploration et renforcer la sécurité de votre site.

👉 Demandez votre audit auprès de TooNetCreation

Une heure suffit pour savoir où vous perdez du trafic…

Contactez-nous et on s’y met.

Promis : pas de jargon inutile, juste des solutions concrètes.

FAQ – Analyse de fichiers journaux & SEO (par Laurent Lacoste)

1. Qu’est-ce qu’un fichier journal (log serveur) en SEO ?

Un fichier journal est un document généré par votre serveur à chaque requête reçue : visite d’un utilisateur, passage d’un robot Google, appel d’une image, erreur, etc.

C’est la seule source “brute” qui montre comment votre site est réellement exploré, loin des impressions ou des suppositions.

2. Pourquoi analyser ses logs améliore le SEO ?

Parce que les logs révèlent :

- les pages les plus (et les moins) explorées par Google,

- les erreurs invisibles dans les outils classiques,

- les redirections qui consomment du budget,

- les URLs inutiles qui diluent l’exploration,

- les contenus importants négligés par les robots.

En clair : les logs vous montrent ce que Google fait réellement, pas ce que vous espérez qu’il fasse.

3. À quelle fréquence faut-il analyser ses fichiers journaux ?

- Petit site vitrine : 1 à 2 fois par an.

- E-commerce, média, site à fort trafic : chaque mois.

- Pendant une refonte ou une chute de trafic : immédiatement.

L’analyse régulière permet de réagir avant que les problèmes n’impactent votre visibilité.

4. Que peut-on découvrir dans les logs que l’on ne voit pas ailleurs ?

Beaucoup de choses, dont :

- des 404 récurrentes ignorées par le CMS,

- des robots d’IA qui explorent vos contenus,

- des boucles de redirections invisibles,

- des pages orphelines jamais découvertes par Google,

- des scripts cassés qui empêchent un bon rendu,

- des attaques en cours sur votre site.

Les logs sont un peu comme le “film de votre serveur”. On y voit tout.

5. Les logs permettent-ils d’améliorer l’exploration Google ?

Oui, et c’est même leur grande force.

Vous pouvez identifier précisément :

- où Google perd du temps,

- quelles pages stratégiques ne sont pas explorées,

- quels types de ressources (JS, images) sont surconsommés,

- comment orienter le bot vers les pages qui comptent vraiment.

C’est un levier très efficace pour optimiser le budget d’exploration.

6. Comment les logs aident-ils à détecter des attaques ?

Les logs montrent des signaux clairs :

- pics de requêtes,

- tentatives de brute-force,

- scans de vulnérabilités,

- exploration de fichiers sensibles,

- URLs suspectes ressemblant à des injections.

C’est souvent le premier endroit où l’on voit une attaque, parfois avant les outils de sécurité.

7. Est-ce que je dois être développeur pour analyser mes logs ?

Pas forcément.

Mais avoir un œil expert aide à interpréter les anomalies, surtout pour :

- les schémas de crawl complexes,

- les redirections invisibles,

- les attaques sophistiquées,

- les interactions entre bots IA et SEO.

Un consultant technique peut analyser les logs, documenter les problèmes, et proposer des actions concrètes.

8. Les logs concernent-ils uniquement les gros sites ?

Non.

Même un petit site peut avoir :

- des pages peu explorées,

- des erreurs cachées,

- des paramètres d’URL inutiles,

- des robots agressifs.

Toute entreprise qui dépend de Google pour sa visibilité devrait faire au moins un audit annuel.

9. Combien de lignes de logs faut-il analyser pour obtenir des insights ?

En général :

- 30 jours suffisent pour repérer les tendances.

- Sur un e-commerce : analyser 90 jours donne une vision plus stable.

L’essentiel est de disposer d’un panel suffisamment large pour voir les patterns.

10. Est-ce que TooNetCreation peut analyser mes logs ?

Oui.

Nous proposons :

- un audit technique complet,

- une analyse du crawl Google,

- un diagnostic sécurité,

- des recommandations concrètes (corrections + priorisation),

- un plan d’optimisation du budget d’exploration,

- un suivi des améliorations.

C’est l’un des domaines où notre expertise technique fait réellement la différence.

Prêt à concrétiser votre projet ?

Posez nous toutes vos questions et nous vous aiderons à y voir plus clair.